人間とロボットをつなぐ技術、BMIとVR

近い将来、私たちは家に居ながら、ロボットを通して世界中とコミュニケーションを取るようになるかもしれない。人間とロボットをつなぐ技術として、ブレイン・マシン・インターフェース(BMI)とバーチャル・リアリティ(VR)が挙げられる。BMIは人間の脳とロボットのセンサーを直接につなぎ、VRはロボットのセンサーが受け取った信号を人間の五感で受け取れるようにする。

脳に刺した電極でインターネット越しにロボットを制御

2008年1月、米国にいるサルの歩行中の脳活動情報をインターネット越しに日本に送ると共に、日本にあるヒト型ロボットの視覚センサーの情報を米国のサルに戻すことで、ロボットのリアルタイムでの歩行制御が成功した。米国では脳内への刺入型電極を用いた「侵襲型」のBMI研究が盛んであり、歩行中のサルの脳活動情報も同様な方法で採取された。いずれは人間の脳がインターネットに接続され、脳内の記憶をたぐることとネットを検索することの境がなくなる日が来るかもしれない。

外部から脳や筋肉の信号を読み取って歩行を制御

一方、日本では脳波(EEG)や脳磁波(MEG)の測定、近赤外分光法(NIRS)といった脳を傷つけない「非侵襲型」の研究が盛んだ。2014年8月、脳から腕の筋肉に伝わった信号を筋電図で読み取り、腰の皮膚に当てた磁気コイルで読み取った信号を歩行中枢に伝え、脊髄を迂回して歩行を制御できることが示された。脳からの信号を筋電図で読み取るのも、歩行中枢を磁気コイルで刺激するのも、どちらも非侵襲型で実現されている。この技術を発展させれば、脊髄損傷で生じる歩行障害を改善できる可能性がある。

ロボットに自分の意識が乗り移ったような感覚

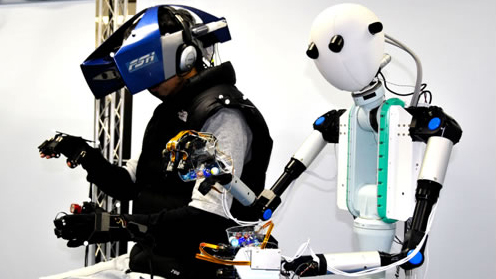

2012年7月、ロボットがいる遠隔地に自身が存在しているかのような高い臨場感を与える「テレイグジスタンス」システムを用いたアバターロボットの最新版が発表され、同年8月5日(現地時間)よりロサンゼルス・コンベンションセンターで展示された(2015年6月15日まで、お台場の日本科学未来館3Fで展示中)。アバターの視覚センサーや聴覚センサーの情報だけでなく、「圧力、振動、温度で触覚を表わすことができる」という独自の原理に基づく触覚センサーの情報も伝送することで、高い臨場感を実現できる。操作用のヘルメットをかぶると、視界がすべてディスプレイの映像に変わる。アバターの視覚センサーがとらえた映像に切り替わると、瞬時に自分の意識がアバターに乗り移ったかのように感じる。はじめは少し乗り物酔いのような感覚を覚える人もいるという。さらに聴覚センサーがとらえた音をヘルメット内のイヤフォンに回すと、一層、アバターが自分自身である感覚が強くなり、アバターからの視点でヘルメットをかぶった自分を見ると不思議な感覚になる。近い将来、世界中に用意されたアバターに自宅からログインすることで、自宅に居ながら世界中で活動し、五感をネット越しにVRで体験できるようになるだろう。

画像提供:科学技術振興機構(JST)